El año 2029 puede ser recordado como el momento en que la humanidad conoció su doble digital: la inteligencia artificial general (AGI). Con el avance de tecnologías como GPT-4, nos acercamos a un punto en el que la IA podría igualar o incluso superar las capacidades cognitivas humanas. Un escenario que plantea una pregunta fundamental: ¿cómo cambiará nuestra vida?

Inteligencia artificial general y singularidad tecnológica: estamos hablando de un cambio de época

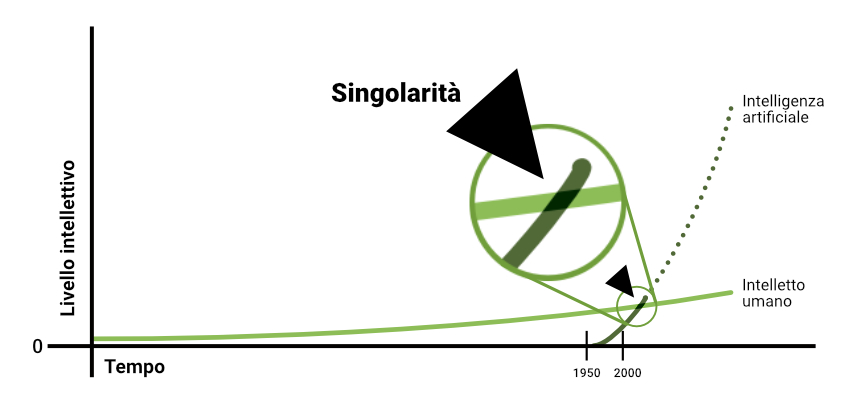

Lo pondré simple: inteligencia artificial general (AGI) es un tipo de inteligencia artificial que puede aprender, comprender y aplicar sus conocimientos en una amplia gama de tareas, tal como lo hace un humano. Básicamente, es como tener una computadora o un robot que puede pensar y resolver problemas en muchas áreas diferentes, no sólo en una específica. La Singularidad Tecnológica es un concepto que evoca imágenes de un futuro en el que la inteligencia artificial general no sólo ayuda a la humanidad, sino que la supera en formas que sólo podemos imaginar hoy. Este evento representa un posible punto de inflexión en la historia de la humanidad. La Singularidad no es sólo un logro tecnológico, sino también un momento de profunda reflexión sobre nuestro papel en un mundo en rápida evolución.

GPT-4 y el enfoque de AGI

GPT-4, la última iteración de los modelos de lenguaje generativo de OpenAI, marcó un paso significativo hacia AGI. Esta tecnología, que ya muestra capacidades de generación y comprensión de lenguajes sorprendentemente avanzadas, es solo la punta del iceberg. Su llegada aceleró el camino hacia un momento que, según previsiones y expectativas previas, era más tardío en los años. desafiando predicciones y expectativas previas. Históricamente, los investigadores de IA han predicho que la Singularidad ocurrirá en promedio alrededor de 2050. Los expertos de Estudios de Futuro, que revisan periódicamente sus estimaciones, se dividen en este rango:

Vernor Vinge, que acuñó el término “Singularidad Tecnológica” y perfeccionó sus conceptos en las décadas de 80 y 90, predijo este punto de inflexión para 2050, a mediados de este siglo. Ben Goertzel, otro destacado investigador en el campo de la IA, predijo entre 2000 y 2010 la inteligencia artificial general (y la Singularidad tecnológica) para finales de la década de 30 de este siglo. ray Kurzweil, en 2005, predijo la llegada del “gran cambio” para 2029. De hecho, escribió un libro al respecto, “La Singularidad está Cerca”.

Y luego está Paul Pallaghy

el ingeniero de IA (y futurólogo) Pablo Pallaghy El doctor de la Universidad de Melbourne quizás haya detallado más que nadie las predicciones sobre la llegada de este momento clave en la historia de nuestra especie. En 2012 trazó una especie de pequeña hoja de ruta que nos acercaría a la inteligencia artificial general, con todas las consecuencias del caso. Partió de una intuición que luego resultó ser correcta: no serían necesarios ordenadores cuánticos para desarrollar modelos de procesamiento del lenguaje natural (NLU), como predijeron varios colegas. Podríamos haberlo hecho con las capacidades computacionales de la informática "tradicional". Fue una predicción que, en retrospectiva, podemos considerar autorizada: Pallaghy estaba trabajando en esos mismos modelos en ese momento.

Para ser conciso, en 2012 estas fueron sus predicciones:

- Comprensión adecuada del lenguaje natural (NLU) para 2020.

- Comprensión del lenguaje natural (NLU) similar a la humana para 2022.

- Inteligencia General Artificial (AGI) para 2024.

- Androides por 2026.

- La Singularidad de la Inteligencia Artificial podría ocurrir ya en 2025, pero casi con certeza para 2029.

Los reiteró varias veces, hasta 2021 en el que los condensó en una publicación de su blog. Muchos compañeros no los recordaban bien, por el simple hecho de que en 2012 probablemente pensaban que estaban locos. La realidad actual, sin embargo, es sorprendentemente similar a los dos primeros puntos. Están apenas un año desfasados. ¿UNL natural? 2021. ¿NLU “humanoide” (GPT-4)? 2023. E adesso?

Estimaciones revisadas de Pallaghy

- 2023: NLU humanoide (logrado con GPT-4).

- 2024: NLU madura y AGI incorpórea avanzada.

- 2025: Miles de androides disponibles por menos de 100.000€.

- 2026: El primer potencial para una singularidad de IA superinteligente e incorpórea.

- 2027: Millones de androides disponibles por menos de 50.000€.

- 2028: El primer potencial para una singularidad de IA basada en Android.

- 2029: Decenas de millones de androides casi superinteligentes disponibles por unos 25.000 euros.

En resumen, su predicción central es una Singularidad en 2028, que sin embargo podría ocurrir ya en 2026. Es esencial comprender una cosa si se quiere captar el significado de las predicciones de Pallaghy. Algo que muchos no entienden, y que mina su capacidad para evaluar el momento de estos fenómenos. La inteligencia artificial general que podría desencadenar la Singularidad, es decir, la hipotética aceleración autónoma de la evolución de la IA, no requiere autoconciencia. No es necesario ser “consciente” para actuar. No tiene por qué ser una "vida artificial". Solo necesita ser un poco más avanzado que GPT-4 (o quizás la próxima iteración, GPT-5), con más memoria a corto y largo plazo y un poco más de entrenamiento para lograr los objetivos adecuados.

Inteligencia artificial general: ¿qué consecuencias?

A medida que avanzamos hacia la AGI, surgen cuestiones éticas y sociales cruciales. ¿Cómo gestionaremos una inteligencia que superará a la nuestra en muchos aspectos? ¿Qué medidas de seguridad y pautas éticas deberíamos implementar para garantizar que su ascenso sea beneficioso para la humanidad? Estas no son simples preguntas teóricas: requieren respuestas concretas y acciones inmediatas.

Es fundamental que nos preparemos adecuadamente. Esto significa no sólo avanzar en la tecnología, sino también pensar en las implicaciones más amplias de la AGI, sobre las implicaciones positivas que tal los negativos. Debemos considerar cómo la AGI afectará el trabajo, la educación, la ética y la sociedad en su conjunto. Es una tarea que requiere la colaboración de científicos, filósofos, legisladores, sociólogos (¡especialmente ellos!) y ciudadanos.

Un futuro incierto, prometedor y peligroso

El camino hacia la Singularidad Tecnológica está lleno de incertidumbres, pero también de inmensas posibilidades. La inteligencia artificial general podría representar una amenaza existencial o una oportunidad sin precedentes para la humanidad. La clave es navegar estos escenarios con sabiduría, prudencia y estar siempre atento a las implicaciones más amplias de nuestras decisiones tecnológicas. Podríamos acercarnos al 2026 y en 2029 podríamos impactar un futuro exorbitante.

Los comentarios estan cerrados.