Los cachalotes se encuentran entre los animales vivos más ruidosos del planeta. Producen crujidos, golpes y clics para comunicarse con otros cetáceos que se encuentran a pocos metros o cientos de kilómetros de distancia.

Esta sinfonía de sonidos de cachalotes es lo suficientemente sofisticada como para calificarla como un lenguaje en toda regla. Pero, ¿los humanos entenderán alguna vez lo que dicen estas ballenas?

La respuesta es: tal vez

Antes de descifrar el idioma de las ballenas, los investigadores deben recopilar y analizar una cantidad sin precedentes de comunicaciones entre cachalotes, esto es poco pero cierto.

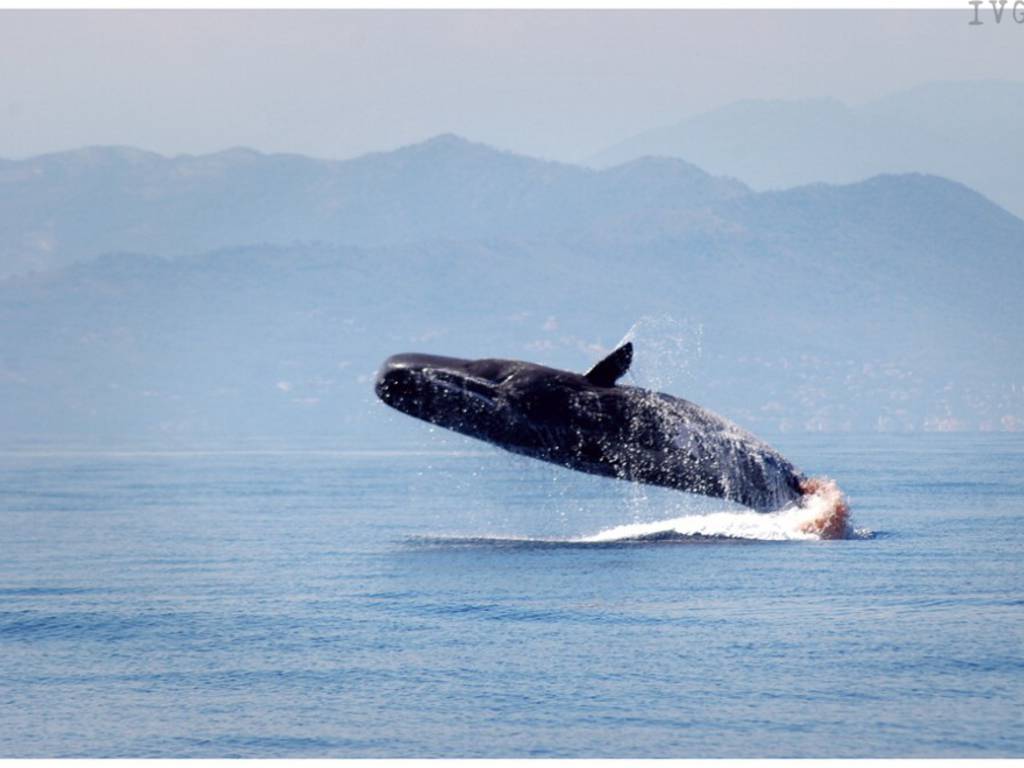

Con un cerebro seis veces más grande que el nuestro, los cachalotes (Physeter macrocephalus) son ballenas con una estructura social compleja, que pasan la mayor parte de su tiempo socializando e intercambiando mensajes. Secuencias de mensajes que pueden ser breves (como 10 segundos) o durar más de media hora. De hecho, "la complejidad y duración de las vocalizaciones de las ballenas sugiere que, al menos teóricamente, son capaces de exhibir una gramática compleja" en comparación con otros animales no humanos.

Esto es lo que leemos en un artículo sobre ballenas de abril de 2021 publicado en arXiv.org.

¿Qué dice este estudio?

Este documento, de un proyecto interdisciplinario conocido como CETI (Iniciativa de traducción de cetáceos), describe un plan para decodificar las vocalizaciones de los cachalotes, primero mediante la recopilación de grabaciones de estas ballenas y luego utilizando el aprendizaje automático para intentar decodificar las secuencias que utilizan para comunicarse. CETI eligió estudiar a los cachalotes sobre otras ballenas porque sus clics tienen una estructura similar al código Morse, que la inteligencia artificial (IA) podría analizar más fácilmente.

Romper el hielo

Lo poco que sabemos sobre los cachalotes lo hemos aprendido recientemente. No fue hasta la década de 50 que notamos que estas ballenas emitían sonidos. Y durante 20 años no entendimos que usaban estos sonidos para comunicarse.

Sin embargo, con un doble propósito. Los cachalotes pueden sumergirse a profundidades de 4.000 pies (1.200 metros). usted tres veces más profundo de submarinos nucleares. Está muy oscuro allí abajo: por lo tanto, estas ballenas han evolucionado para buscar calamares y otros alimentos utilizando estos sonidos también para ubicarse, como un sonar. Este mismo tipo de sonido también se utiliza en sus vocalizaciones sociales, aunque los clics de comunicación son más densos en ese caso, según el documento CETI.

Entender esto también fue difícil

Los cachalotes han sido durante mucho tiempo muy difíciles de estudiar para los humanos. Ahora tenemos las herramientas para poder mirar más profundo que nunca gracias a la inteligencia artificial, la robótica y los drones.

david gruber, biólogo marino y líder del proyecto CETI.

Pratyusha Sharma, investigadora en ciencia de datos para CETI y estudiante de doctorado en el Laboratorio de Ciencias de la Computación e Inteligencia Artificial del MIT, confía mucho en los desarrollos recientes en inteligencia artificial y modelos de lenguaje, como GPT-3, que utiliza el aprendizaje profundo para crear historias o textos humanos. Los científicos esperan que estos mismos métodos se puedan aplicar a las vocalizaciones de los cachalotes para construir su lenguaje. Solo hay un problema: estos métodos tienen un apetito voraz por los datos.

Tenemos 100.000 registros, ¡pero necesitamos 4 mil millones!

El proyecto CETI actualmente tiene registros de alrededor de 100.000 clics de ballenas, cuidadosamente recopilados por biólogos marinos durante muchos años, pero los algoritmos de aprendizaje automático pueden necesitar alrededor de 4 mil millones de estos clics. Para llenar este vacío, CETI está creando varios canales automatizados para recolectar registros de cachalotes. Los métodos incluyen micrófonos subacuáticos colocados en aguas frecuentadas por ballenas y micrófonos que se pueden dejar caer desde drones voladores. Incluso peces robóticos que pueden seguir y escuchar a las ballenas sin llamar la atención.

Pero incluso con todos estos datos, ¿podremos descifrarlos?

Muchos de los algoritmos de aprendizaje automático han encontrado que el audio es más difícil de analizar que el texto. Por ejemplo, puede resultar difícil analizar dónde comienza y dónde termina una palabra. Como explicó Sharma, “Supongamos que existe la palabra 'paraguas'. ¿Es "om" la palabra? ¿O es "brello"? ¿O es un "paraguas"? " Las barreras entre las palabras habladas son más ambiguas y menos regulares y, por lo tanto, los patrones pueden requerir que se descubran muchos más datos.

No es la única dificultad que tendrá que afrontar el CETI.

“Ya sea que alguien venga de, digamos, Japón o Estados Unidos o de cualquier otro lugar, los mundos de los que estamos hablando son muy similares; hablamos de la gente, hablamos de sus acciones ”, dijo Sharma. “Pero los mundos en los que viven estas ballenas son muy diferentes, ¿verdad? Y los comportamientos son muy diferentes ".

Además, de un estudio de 6 años publicado en 2016 en la revista Ciencia Real Sociedad Abierta, se sabe que los cachalotes incluso tienen dialectos.

Si eso le parece una gran dificultad, piense en ir a la luna. Estas dificultades son precisamente las que hacen que el proyecto sea tan ambicioso y valioso. Lo que una ballena le dice a otra es hoy tan oscuro como las aguas en las que nada, pero es un misterio que hace que CETI sea muy, muy intrigante.