¿Qué puede revelar un rostro inexpresivo sobre su orientación política? Mucho más de lo que imaginas, según un estudio reciente que utilizó inteligencia artificial para predecir la orientación política a partir de fotografías faciales. Incluso al controlar variables como la edad, el género y el origen étnico, los algoritmos de reconocimiento facial pudieron adivinar creencias políticas con una precisión comparable a la de los humanos. Pero ¿cuáles son las implicaciones de este descubrimiento para nuestra privacidad en la era digital?

Reconocimiento facial: lo bueno y lo malo

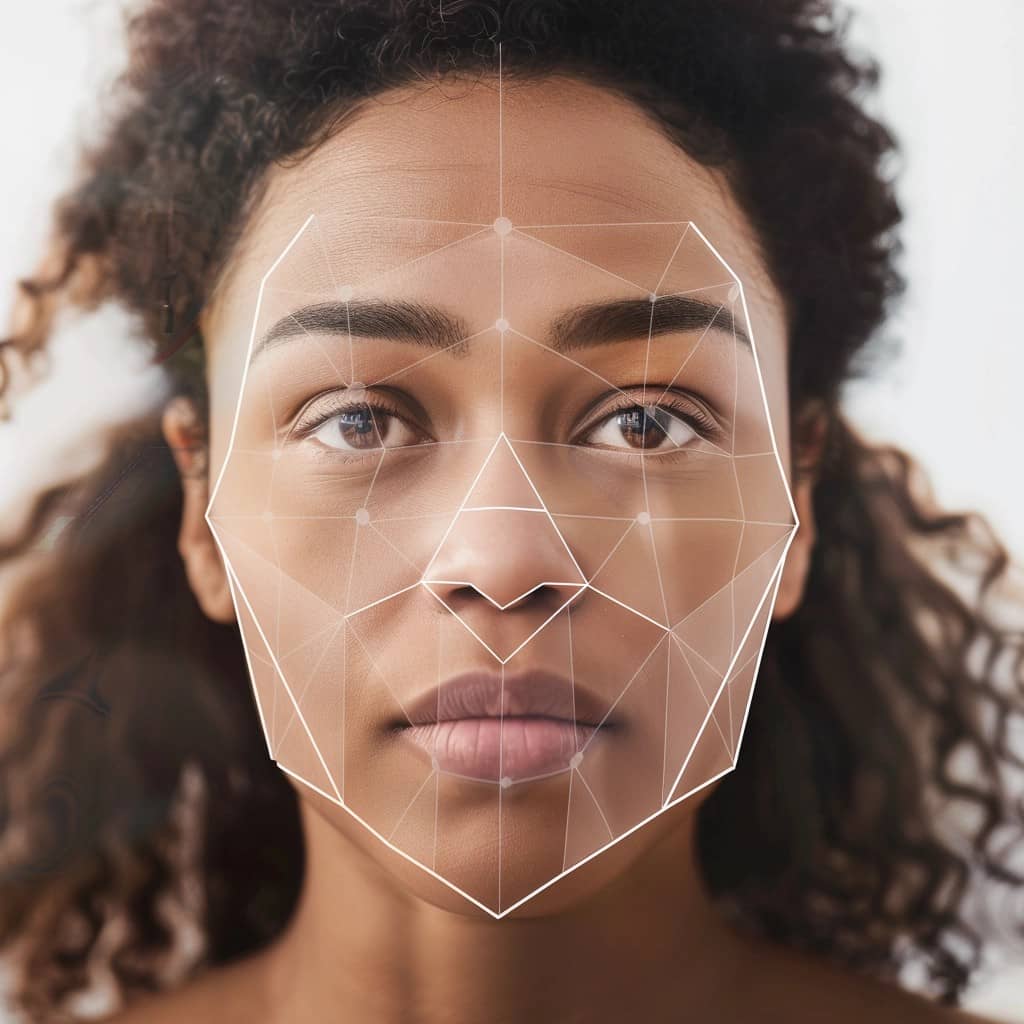

Il reconocimiento facial es una forma de inteligencia artificial que identifica y verifica a los individuos analizando patrones basados en sus características faciales. Básicamente, la tecnología utiliza algoritmos para detectar rostros en imágenes o videos. Luego mide varios aspectos del rostro, como la distancia entre los ojos, la forma de la mandíbula y el contorno de los pómulos.

Estas medidas se transforman en una fórmula matemática, una “firma facial”, que puede compararse con una base de datos de rostros conocidos para encontrar una coincidencia, o usarse en diversas aplicaciones que van desde sistemas de seguridad hasta desbloquear teléfonos y etiquetar amigos en las redes sociales.

Con el uso cada vez mayor de tecnologías de reconocimiento facial tanto en el sector público como en el privado, aumenta la posibilidad de que estas herramientas se utilicen para fines que van más allá de la simple identificación, como predecir atributos personales. Por ejemplo, y este es el caso, la orientación política.

Predecir la orientación política: el estudio

En su nuevo estudio publicado en la revista Psicóloga americana (lo enlazo aqui), investigadores dirigidos por Michal Kosinski, profesor asociado de comportamiento organizacional en la Universidad de Stanford, siguió un ejemplo particular. ¿El objetivo? Aislar la influencia de las características faciales por sí solas en la predicción de la orientación política. El trabajo se centró en variables como las expresiones y la orientación de la cabeza.

Para hacer esto, reclutaron 591 participantes de una gran universidad privada y tomaron sus fotografías en un ambiente altamente controlado. Todos los sujetos vestían camisetas negras, se habían quitado el maquillaje y tenían el pelo recogido. Las fotografías fueron tomadas en una posición fija, en una habitación bien iluminada y sobre un fondo neutro.

Luego, las imágenes fueron procesadas mediante un algoritmo de reconocimiento facial, que extrajo "descriptores faciales" numéricos. Estos descriptores codifican rasgos faciales en una forma analizable por computadora. Y se utilizaron para predecir la orientación política de los participantes a través de un modelo que los mapeaba en una escala de orientación política.

La IA adivina la orientación política mejor que los humanos

¿Los resultados? Son sorprendentes. El algoritmo de reconocimiento facial pudo predecir la orientación política con un coeficiente de correlación de 0,22. Aunque modesta, esta correlación es estadísticamente significativa y sugiere que algunas características faciales estables pueden estar relacionadas con la orientación política, independientemente de otros factores demográficos.

Pero eso no es todo. En un segundo paso, los investigadores reemplazaron el algoritmo. con 1.026 evaluadores humanos, pidiéndoles que estimaran la orientación política a partir de las mismas imágenes estandarizadas. Sorprendentemente, los humanos también pudieron predecir la orientación política con una precisión comparable a la del algoritmo. Con un coeficiente de correlación de 0,21. Un poco peor, en definitiva.

Finalmente, en una tercera fase, los investigadores aplicaron el modelo a un conjunto de imágenes de políticos, para validar los resultados en un escenario más real. Una vez más, el modelo de reconocimiento facial pudo predecir la orientación política con una precisión significativa. Demostrando que algunos de los rasgos faciales predictivos también pueden identificarse en imágenes más diversas.

Implicaciones futuras: una amenaza sin precedentes

Los hallazgos de este estudio plantean importantes preocupaciones sobre la privacidad. El reconocimiento facial se puede utilizar sin el consentimiento o conocimiento de los sujetos.

Las imágenes faciales pueden ser tomadas fácilmente (y en secreto) por las fuerzas del orden u obtenidas de archivos digitales o tradicionales, incluidas redes sociales, plataformas de citas, sitios para compartir fotografías y bases de datos gubernamentales. A menudo son de fácil acceso: cualquier persona puede ver las fotos de perfil de Facebook y LinkedIn, por ejemplo, sin su consentimiento o conocimiento.

Por lo tanto, las amenazas a la privacidad que plantea la tecnología de reconocimiento facial no tienen precedentes en muchos sentidos. Y con el uso cada vez mayor de estas herramientas tanto en el sector público como en el privado, el riesgo de abuso y vigilancia masiva se vuelve cada vez más real.

El futuro del reconocimiento facial: derechos de voto y derechos faciales

El estudio de Kosinsky y colegas abre una ventana a un futuro en el que la tecnología de reconocimiento facial podría usarse para revelar aspectos íntimos de nuestra identidad, como la orientación política, sin nuestro consentimiento o conocimiento. Pero también plantea muchas cuestiones y desafíos éticos.

¿Cómo podemos equilibrar los beneficios potenciales de esta tecnología, como mejorar la seguridad o personalizar los servicios, con los riesgos para la privacidad y la libertad individual? ¿Cómo podemos garantizar que estas herramientas no se utilicen con fines discriminatorio u opresivo, especialmente hacia las minorías y los grupos vulnerables?

No hay respuestas fáciles para esas preguntas. Pero hay que buscarlas cuanto antes, porque el rostro que vemos cada mañana en el espejo no es sólo un conjunto de características biométricas que hay que analizar y clasificar. Es el reflejo de nuestra humanidad, nuestra individualidad, nuestra libertad de pensamiento y expresión.

Y son valores que ningún algoritmo, por sofisticado que sea, tendrá que controlar jamás.