La inteligencia artificial (IA) tiene el potencial de revolucionar nuestro mundo. Y, obviamente, esta promesa conlleva un riesgo importante.

Bueno, al menos en mi horizonte cognitivo veo claramente prevalecer la parte pesimista de la discusión. Por alguna razón que no sé, incluso los propios desarrolladores de IA tienden a perseguirse entre sí. con "todos moriremos", solo para ganar buen dinero con sus plataformas.

En cambio, hay un puñado de personas que creen que la perspectiva de un auge de la inteligencia artificial es salvadora.

En otras palabras, parece que la humanidad sólo tiene dos opciones en nuestro enfoque de la inteligencia artificial:

- Tememos las posibles consecuencias negativas de la IA avanzada y, por tanto, intentamos detener su desarrollo;

- Apreciamos los beneficios de la IA avanzada y, por lo tanto, nos esforzamos por lograr estos beneficios lo más rápido posible a pesar de los riesgos.

En mi Nápoles la síntesis eficaz estaría en un dicho famoso: "o 1 o 90". ¿A qué se debe este total desequilibrio? ¿Hay algún término medio?

El camino de la responsabilidad

Nuestra visión "binaria", esclerotizada por las redes sociales y los medios que relanzan la declaraciones sensacionalistas o apocalíptico, descuidar un camino. Y es una gran lástima, porque es el mejor camino, el único que puede ayudarnos a conseguir los beneficios deseados de la IA avanzada: el desarrollo responsable.

Hagamos una analogía: imaginemos un viaje a una especie de valle dorado. Imaginemos, entonces, que frente a este valle hay una especie de pantano incierto, quizás poblado por depredadores hambrientos que se esconden en las sombras.

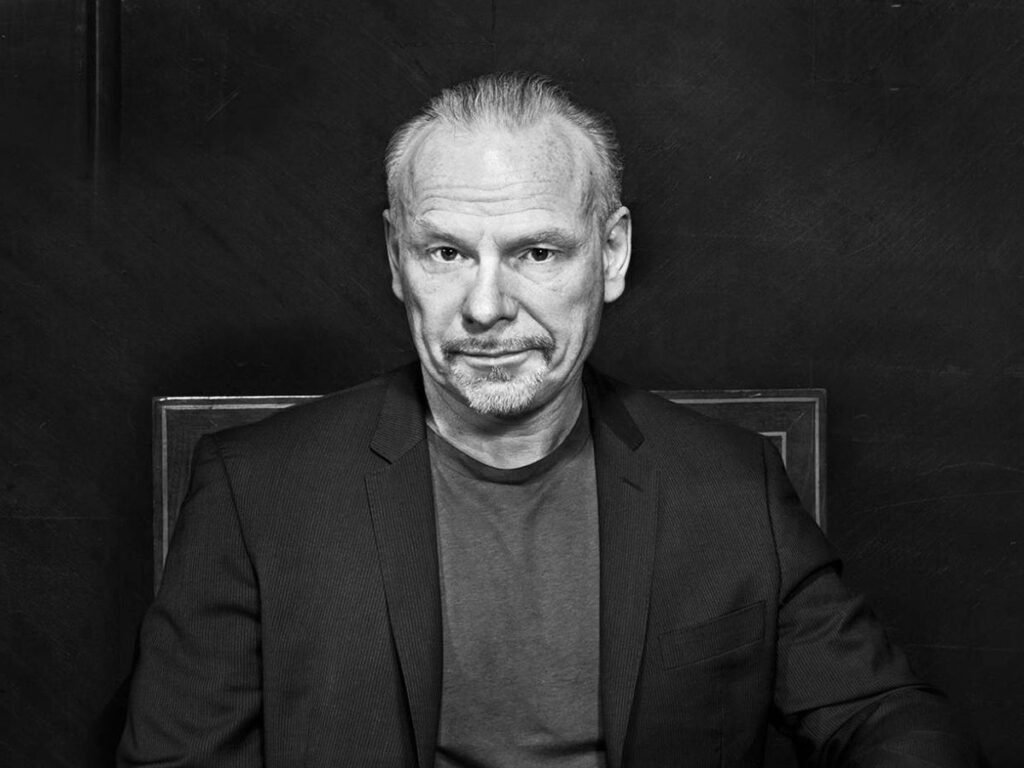

¿Solo tenemos la opción entre atravesarlo o huir? ¿Entre el miedo (y la huida) y la imprudencia (avanzar sin precauciones)? ¿O hay una tercera vía, la de comprender mejor la situación y buscar con equilibrio la forma más segura de cruzar el río? Usted ya sabe la respuesta. Incluso los más asustados la conocen. Y para aquellos centrados sólo en el “riesgo existencial” y no en el hecho de que también existe una “oportunidad existencial” recomiendo esta reflexion del filósofo y experto en tecnologías emergentes, Max Más.

La evaluación de riesgos pasa por el equilibrio.

Dejando a un lado las metáforas, el viaje es hacia una “superabundancia sostenible” que podría lograrse con la ayuda de una IA avanzada, siempre que actuemos con sabiduría y equilibrio.

¿Y cómo actúas sabiamente? En primer lugar, sentando las bases de la regulación tradicional. Según algunos filósofos y expertos en tecnologías emergentes, poner la inteligencia artificial en "binarios" reduce su capacidad de aprendizaje y sus potenciales beneficios. Depende.

En el contexto de un futuro próximo en el que tendremos cada vez más inteligencias artificiales "locales" y específicas (incluso asistentes completamente personales), pueden y deben ser sensibles al alcance de los posibles fallos. Cuando las fallas son locales, entonces tiene sentido permitir que ocurran. Pero cuando existe el riesgo de un resultado global, se necesitará una mentalidad diferente, la del desarrollo responsable.

En pocas palabras: no es prudente detener la inteligencia artificial, y no es prudente dejarla funcionar libremente. Como hemos dicho, ninguno de los dos caminos actuales (parar o correr) nos lleva a nada bueno.

No debemos parar, no debemos correr

Lo que se necesita con urgencia es una investigación más profunda y reflexiva sobre los diversos escenarios en los que las fallas de la IA pueden tener consecuencias catastróficas. Debemos evaluar qué sectores corren mayor riesgo y qué daños podríamos sufrir, y luego introducir nuevas "reglas" (posiblemente no evitables). como las de Asimov) para que no se desborde.

Sólo así podremos aumentar significativamente la probabilidad de encontrar una manera segura de cruzar ese pantano de incertidumbre que se interpone entre nosotros y la Singularidad tecnológica.