Nvidia, el gigante de las GPU que ha conquistado el mundo de la inteligencia artificial, no muestra signos de desaceleración. De lo contrario, con la presentación de la nueva GPU Blackwell B200 y el "superchip" GB200, parece decidido a ampliar aún más su ventaja sobre la competencia.

Estos monstruos de la potencia informática, con hasta 30 veces más rendimiento que el ya impresionante H100, prometen redefinir los horizontes de la IA y consolidar el dominio de Nvidia en un sector cada vez más estratégico y competitivo.

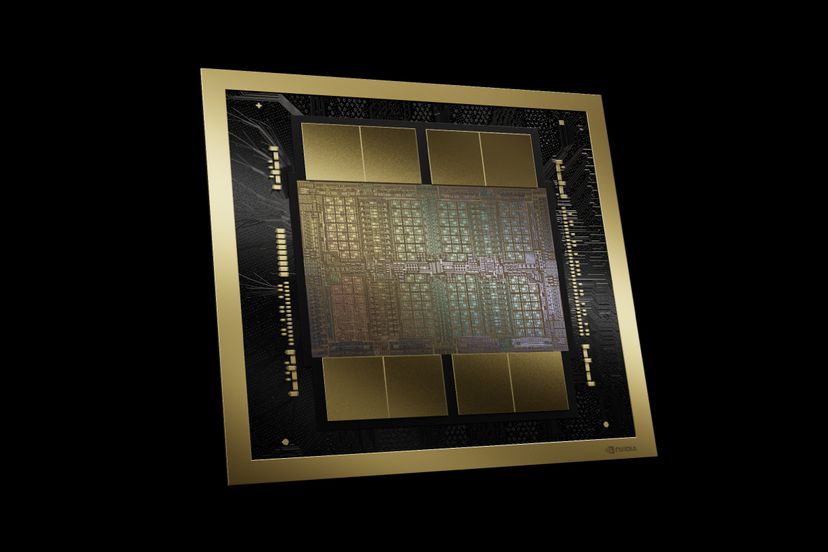

Blackwell B200, 208 mil millones de transistores y 20 petaflops de pura potencia

Los números te hacen girar la cabeza. La nueva GPU B200 incluye la friolera de 208 mil millones de transistores (sí, leíste bien, miles de millones) en un solo chip, liberando hasta 20 petaflops de potencia informática de punto flotante (FP4) de 4 bits. Para que os hagáis una idea, este es un poder comparable al de 20 millones de portátiles de alta gama. Y todo ello en un único chip del tamaño de una postal.

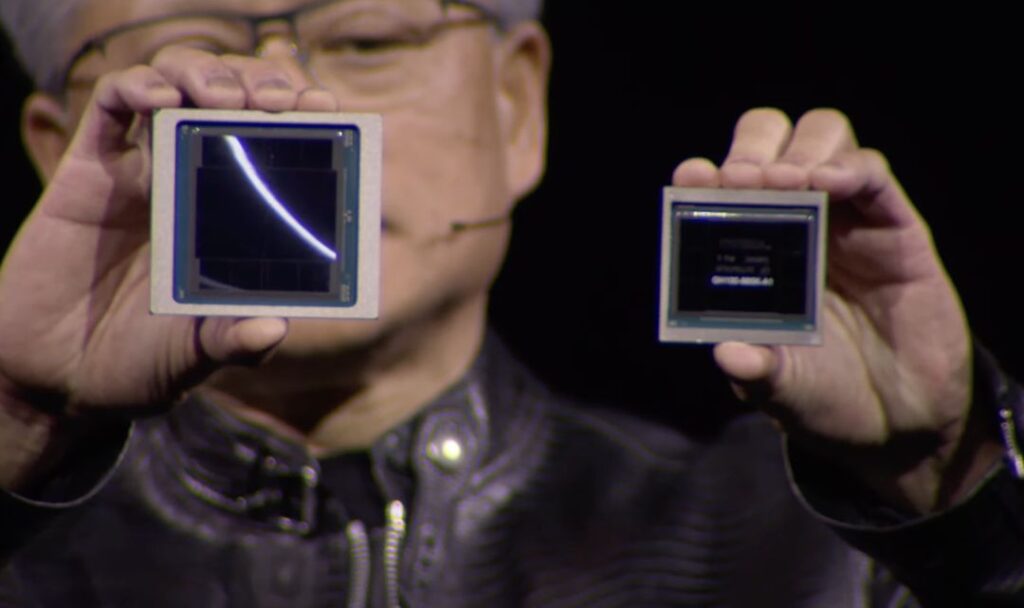

Pero el verdadero as en la manga de Nvidia es el Blackwell GB200, un "superchip" que fusiona dos GPU B200 con una CPU Grace en un solo paquete. Esta bestia de 30 petaflops promete ofrecer hasta 30 veces el rendimiento del H100 en tareas de inferencia de modelos de lenguaje grande (LLM), con una reducción del 25 % en costos y consumo de energía. En dos palabras: Más potencia, menos gasto, menos impacto ambiental. Sí, había 7 palabras.

Cuando un chip no es suficiente, el "motor transformador" se encarga de ello

¿Cómo saca Nvidia todo este poder? Uno de los secretos reside en el "motor transformador" de segunda generación: una arquitectura dedicada que duplica la capacidad informática, colocando más neuronas en menos espacio, para redes neuronales cada vez más grandes y de mayor rendimiento.

¿Qué sucede cuando juntas docenas o cientos de estos chips en un servidor? Hasta 576 GPU pueden “comunicarse” entre sí con un ancho de banda bidireccional de 1,8 terabytes por segundo. En tres palabras (esta vez de verdad, lo juro): Computación paralela extrema.

De los chips a las supercomputadoras, un paso corto

Si quieres tener una idea de lo que veremos pronto, los sistemas que impulsarán estos Blackwell podrán entrenar modelos con 27 billones de parámetros. GPT-4 cuenta con “sólo” 1,7 billones.

Nvidia parece estar lanzando un desafío a todo el mundo de la IA: ¿quieres ir rápido? Síganos. Y los grandes actores de la nube parecen haber captado el mensaje: Amazon, Google, Microsoft y Oracle ya se han alineado para ofrecer estas baratijas en sus servicios. Una señal de que el hambre por potencia informática es más fuerte que nunca.

Con Blackwell, ¿Nvidia está acabando con el mercado?

Hay quienes desprecian este poder excesivo de Nvidia, que corre el riesgo de crear un monopolio de facto en un sector clave como el de la inteligencia artificial. Es bueno hacer la pregunta. Hay quienes temen que esta carrera hacia lo “más grande, más rápido y más poderoso” pueda conducir a un desarrollo descontrolado de sistemas de IA cada vez más complejos e impredecibles. Ésta también es una pregunta legítima.

Porque más allá de estos interrogantes, con Blackwell y GB200 Nvidia ha demostrado que tiene el pie pisado en el acelerador de la innovación. Malo. Y que no tengo intención de eliminarlo.

Nos guste o no, el futuro de la IA habla cada vez más el lenguaje de las GPU. Y tiene la cara astuta de Jensen Huang.