Ayer, OpenAI se reunió con el garante italiano para la protección de datos personales, para abordar los problemas de privacidad que llevaron al bloqueo temporal de ChatGPT en Italia. El chatbot de inteligencia artificial fue bloqueado por la misma empresa estadounidense, como medida de precaución, luego de que los mensajes y la información de pago de unos usuarios fueran expuestos a otros en una (desastrosa) filtración de datos el 20 de marzo.

Este es el primer caso en el que una democracia impone un bloqueo a una plataforma de IA de esta magnitud. Una operación en sí misma no exenta controversia y sombras. De cualquier manera, OpenAI ha prometido proponer pasos para abordar las preocupaciones, aunque aún no se han detallado completamente. La noticia viene directamente en una nota en el mismo sitio web oficial de la autoridad italiana.

Hablemos

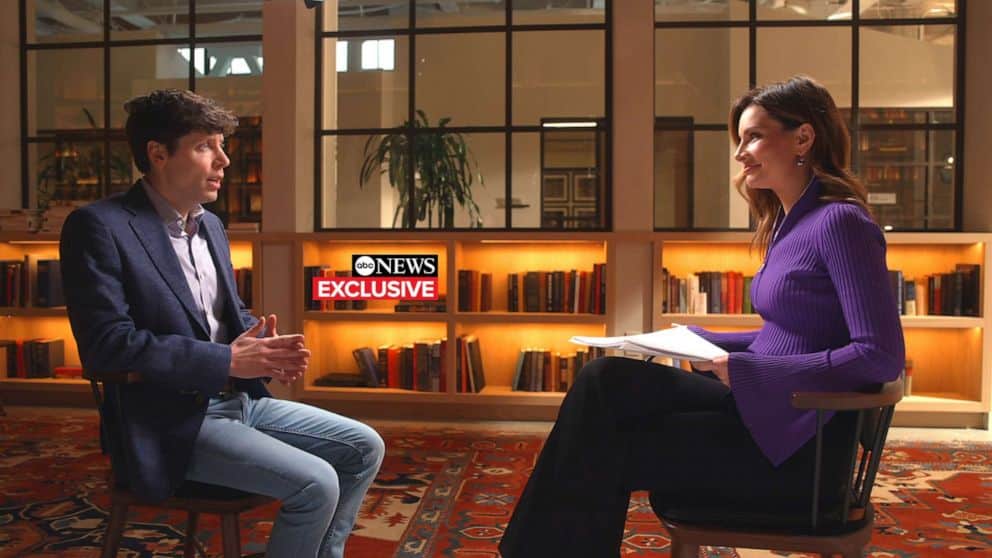

En la videollamada de ayer entre los comisionados del Garante y los directivos de OpenAI, incluido el CEO Sam Altman, hemos asistido al primer verdadero alivio en todo este asunto que mantiene (no bromeo) en vilo a empresas y particulares (y el ratón sobre las VPN, cuyos registros se han disparado). Por su parte, la empresa de Altman se ha comprometido a presentar medidas para abordar las preocupaciones. El Garante, sin embargo, subrayó la importancia del cumplimiento de las rigurosas normas de privacidad de los 27 países de la UE. En particular, cuestionó la base legal para recopilar enormes cantidades de datos utilizados para entrenar algoritmos. ChatGPT y expresó su preocupación de que el sistema podría generar información falsa sobre las personas.

La compensación del Garante

El verdadero quid de todo el asunto, sin embargo, probablemente fruto de la fuerte fibrilación de varios sectores (y de muchos usuarios), fue la mano tendida por el Garante. Los Comisarios expresaron muy claramente su deseo de no obstaculizar el desarrollo de la IA en Italia. Y esto sólo puede impedir un resultado "feliz" de todo el asunto.

¿Que pasa ahora?

OpenAI dijo que está trabajando para eliminar información personal de los datos de entrenamiento cuando sea posible, configurar sus modelos para rechazar solicitudes de información personal de individuos privados y actuar ante solicitudes para eliminar información personal de sus sistemas. ¿Caso cerrado entonces? No. En Italia, como ya hemos dicho, la impresión es que habrá una reapertura del sistema. Sin embargo, en términos más generales, las autoridades están "calentando motores" para cerrar la brecha e intentar regular el sector.

Otros reguladores en Europa y otros lugares comenzaron a prestar más atención después de la acción de Italia. La Comisión Irlandesa de Protección de Datos dijo que estaba "en contacto con la Autoridad de Supervisión italiana para comprender la base de sus acciones y coordinar con todas las autoridades de protección de datos de la UE en relación con este asunto". El regulador francés de privacidad de datos, CNIL, dijo que inició una investigación tras recibir dos quejas sobre ChatGPT. También el comisionado de privacidad de Canadá. abrió una investigación en OpenAI. Y lo hizo tras recibir una denuncia por la supuesta "recopilación, uso y divulgación de información personal sin consentimiento".

Por otro lado, el viaje de la IA apenas comienza, ¿verdad?