Investigadores de la Universidad de Stanford han logrado un avance significativo en el desarrollo de interfaces cerebro-computadora (BCI). Al crear tecnología que puede descifrar el lenguaje hablado a velocidades de hasta 62 palabras por minuto, el equipo mejoró el récord anterior en casi 3 veces.

Un desarrollo que acerca un poco más estos sistemas a los ritmos de una conversación natural, y a una conversión de voz prácticamente instantánea.

Libertad condicional, libertad condicional, libertad condicional

El cofundador de Neuralink junto con Elon Musk, max hodak, calificó la investigación de Stanford como "un cambio significativo en la utilidad de los implantes cerebro-computadora". ¿Pero en qué consiste exactamente?

El quid de todo el trabajo, detallado en un documento que enlazo aquí, es la capacidad de "traducir" señales cerebrales en un habla coherente mediante un algoritmo de aprendizaje automático. Y hágalo analizando la actividad cerebral en una región relativamente pequeña de la corteza.

¿El objetivo? Ayudar a recuperar la voz a personas que ya no pueden hablar debido a enfermedades como la ELA. Un verdadero salto de calidad: una interfaz vocal de este tipo podría acelerar significativamente la decodificación de las señales cerebrales.

Yo evalúo

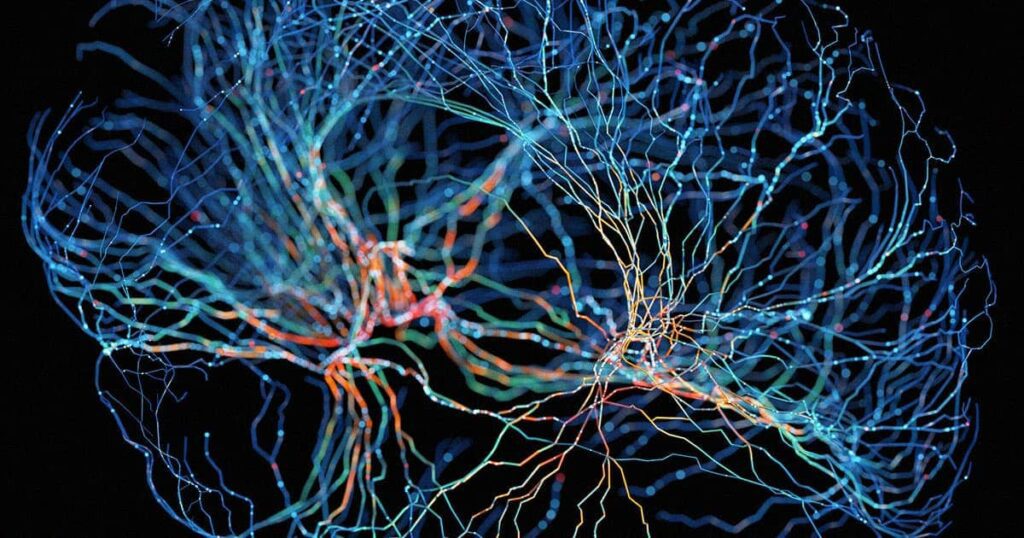

En un experimento, el equipo registró (en dos pequeñas áreas del cerebro) la actividad neuronal de un paciente con ELA que puede mover la boca pero tiene dificultades para formar palabras.

Usando un decodificador de red neuronal recurrente que puede predecir texto, los investigadores transformaron estas señales en palabras. Palabras que van a un ritmo nunca antes visto.

Se ha descubierto que el análisis de los movimientos faciales y las actividades neuronales asociadas es lo suficientemente potente como para sustentar un sistema de interfaz cerebro-computadora a pesar de la parálisis y la extensión limitada de la corteza cerebral.

Los desafíos a enfrentar

Actualmente, el sistema es rápido, pero aún imperfecto: la tasa de error del decodificador de red neuronal recurrente (RNN) utilizado por los investigadores sigue siendo el 20%.

Los investigadores lo saben bien: "Nuestra demostración", escriben, "es evidencia de que decodificar intentos de movimientos del habla a partir de grabaciones intracorticales es un enfoque prometedor, incluso si aún no es un sistema completo y clínicamente viable".

Para mejorar la tasa de error y optimizar el algoritmo, los estudios ahora tendrán como objetivo sondear más áreas del cerebro.

Imagine tales tecnologías combinadas con inteligencia artificial. Algoritmos capaces de clonar perfectamente una voz, como el presentado recientemente por Microsoft que toma sólo 3 segundos de audio.

En el futuro, nadie permanecerá en silencio.