En Nueva York, EE.UU., hay una pequeña startup llamada IA de Hume que tiene una idea noble. ¿Cual? Esto: los sistemas de IA no solo pueden comprender el lenguaje y la información, también deben comprender los sentimientos, las relaciones y las emociones humanas.

¿Demasiado idealista? Sara. Mientras tanto, en torno a esta idea ya se han recaudado fondos por casi 13 millones de dólares.

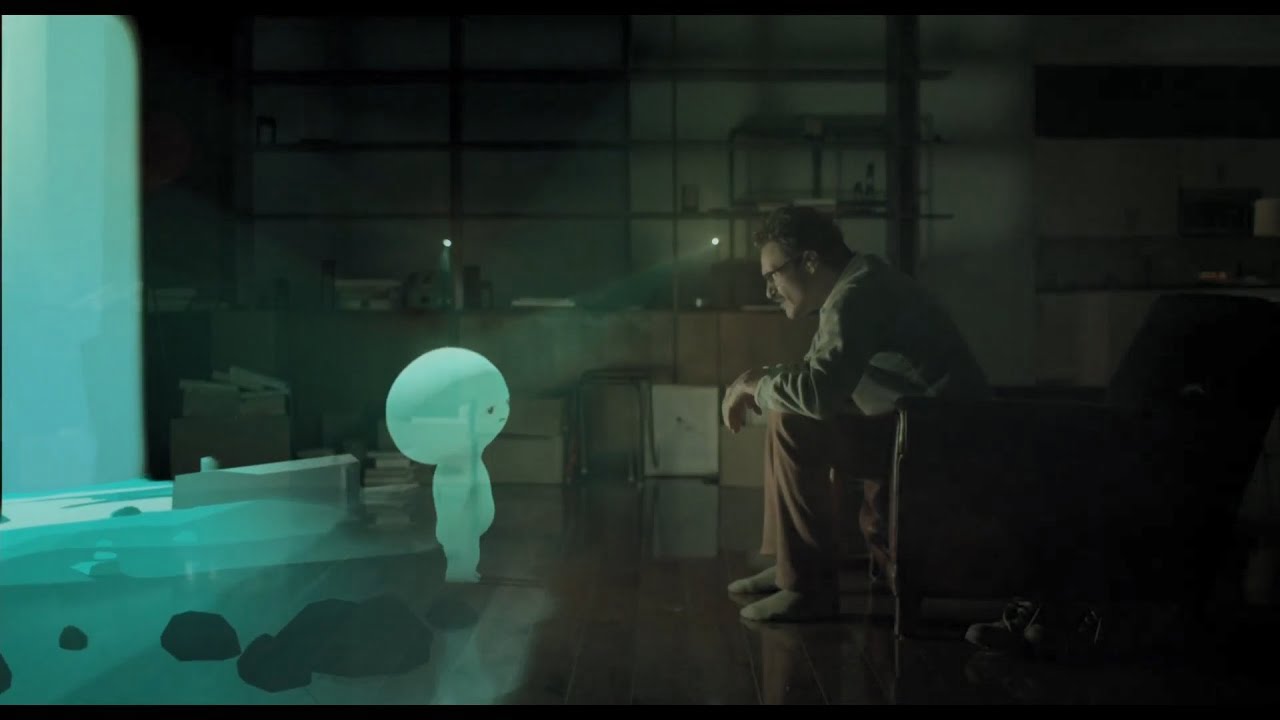

Si quieren entender el mundo, también deben entendernos a nosotros.

El director ejecutivo de Hume AI, Alan Cowen, científico computacional especializado en el estudio de las emociones, parece tener las ideas bastante claras. Destaca la necesidad de que la IA se centre en las emociones humanas en lugar de imitar el pensamiento crítico.

Para ello, dice, su startup pretende ayudar a los sistemas automatizados a comprender mejor los sentimientos de los seres humanos, como la felicidad o la frustración.

La tecnología de inteligencia artificial combinada con la capacidad de detectar emociones humanas podría mejorar la eficacia de los sistemas basados en IA.

Llámalos, si quieres, emociones (humanas)

No solo luces, en realidad. En cuanto a la inteligencia artificial, como ocurre con todas las tecnologías que acaban de explotar, hay muchas sombras. Uno por encima de todo: crear IA capaz de comprender las emociones humanas aumenta el riesgo de manipular estas emociones.

Cowen dice que ha incorporado salvaguardias en sus protocolos y asegura que Hume AI pedirá a sus clientes que respeten una serie de límites al utilizar la tecnología.

Entre estas, precisamente la prohibición de su uso con fines de vigilancia o manipulación, para evitar que las personas sean engañadas jamás. ¿Cómo? Haciéndoles creer que están conversando con un ser sensible, o incluso con una persona real.

"La inteligencia artificial debe usarse para mejorar nuestra felicidad, no para impulsar compras o generar clics".

Yo espero que sí.