El pasado mes de noviembre Meta ha anunciado lo que habría acabado con su tecnología de etiquetado de reconocimiento facial. Hoy, Microsoft también está al mismo nivel, con el objetivo de tranquilizar a los clientes. Retirará gradualmente su IA de reconocimiento facial que puede detectar emociones (y más).

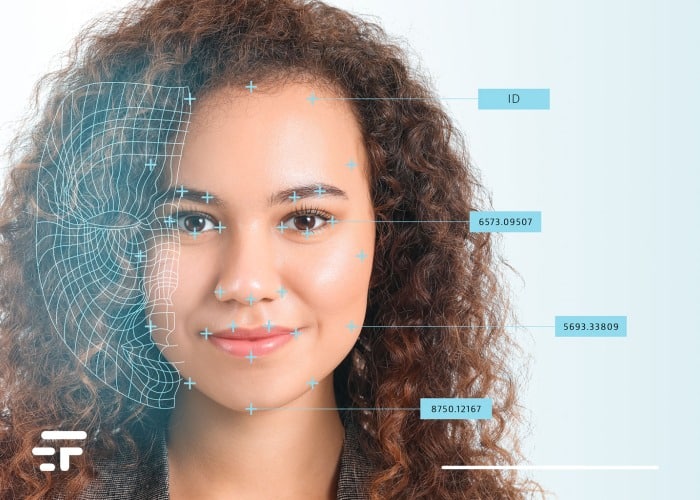

De acuerdo con el portal Engadget esta tecnología simplemente no puede decir si estás triste, feliz o enojado. Con su capacidad para identificar perfectamente características como la edad, el sexo y el cabello, el software de inteligencia artificial del gigante de Redmond ha suscitado inevitables (y legítimas) controversias sobre privacidad.

El largo adiós

En una publicar en el blog de Microsoft, leí que los nuevos usuarios del framework de programación Cara de microsoft ya no podrán acceder a sus funciones. ¿Qué pasa con los clientes existentes? Tranquilos: podrán recurrir a la tecnología "solo" fino al 30 de junio de 2023.

La decisión es parte del plan de Microsoft para desarrollar e implementar tecnología de inteligencia artificial. Una nueva estrategia “más ética” que brindará acceso al software de reconocimiento facial solo a través de las plataformas propietarias Azure Face API, Computer Vision y Video Indexer.

Descontinuaremos las funciones de análisis facial que pretenden determinar las emociones y los rasgos de identidad, como el género, la edad, la sonrisa, el vello facial, el cabello y el maquillaje.

Del lanzamiento de Microsoft

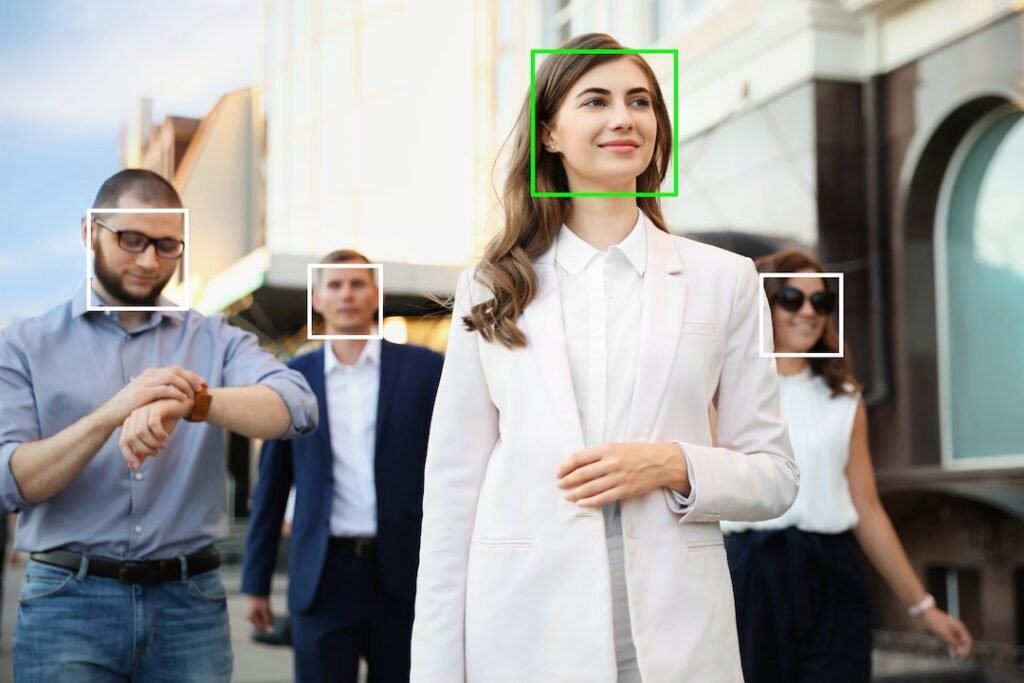

Los llamas si quieres emociones

Ni que decir tiene, te lo imaginarás: acceder a funciones con atributos sensibles abre un amplio abanico de posibilidades de abuso. La selección de personas sobre la base de estos parámetros corre el riesgo de someterlas a prejuicios, discriminación o denegación injusta de servicios.

A medida que la IA se vuelve más poderosa y más pronto se vuelve sensible (sin importar qué este aún no es el caso) necesita atención. Es hora de que las grandes empresas tomen medidas para garantizar que la privacidad y la información del consumidor no se vean comprometidas y que esta tecnología no se utilice con fines maliciosos.