Si sonríe a alguien y no responde, probablemente lo encontrará desagradable. ¿No? Bueno, este robot te daría más satisfacción que algún vecino.

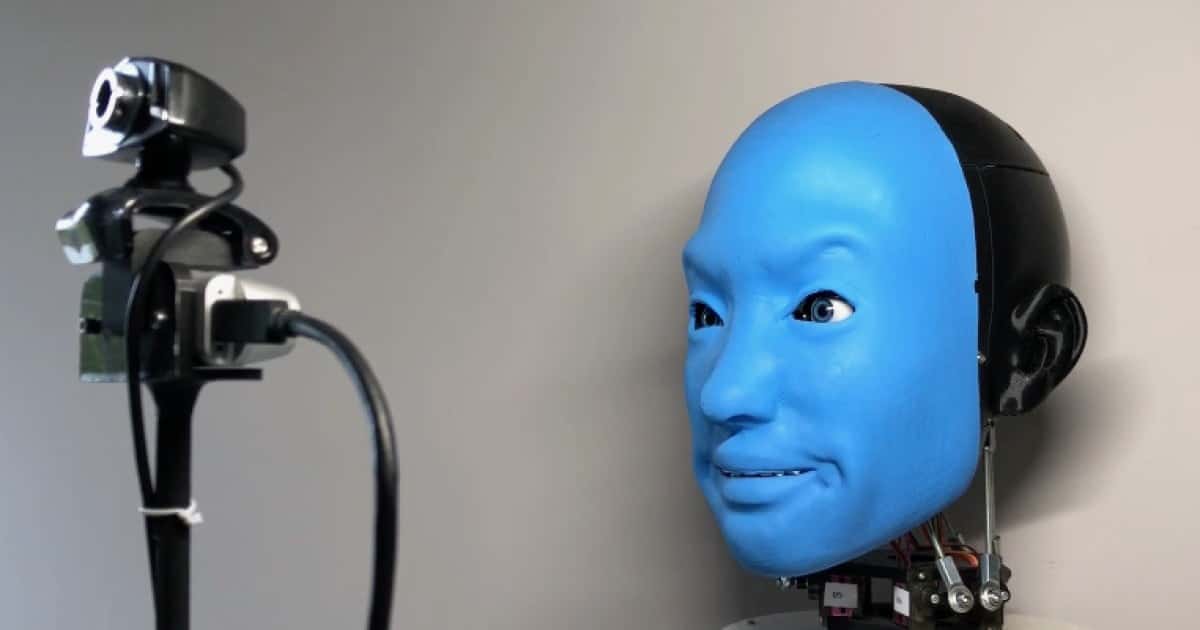

Desarrollado por un equipo de investigadores en ingeniería de la Universidad de Columbia en la ciudad de Nueva York, el proyecto EVA en realidad es uno testa robótica humanoide. Está diseñado para explorar la dinámica de las interacciones humano / robot a través de expresiones faciales. Consiste en una calavera sintética para adultos impresa en 3D con una cara de goma blanda en la parte delantera.

Los motores dentro del cráneo tiran y sueltan selectivamente los cables conectados a varias ubicaciones en la parte inferior de la cara, al igual que los músculos debajo de la piel de nuestra cara nos permiten mostrar diferentes expresiones faciales. Por su parte, EVA puede expresar emociones como ira, disgusto, miedo, alegría, tristeza y sorpresa, así como "un conjunto de emociones más matizadas".

Un robot que imita nuestras expresiones faciales.

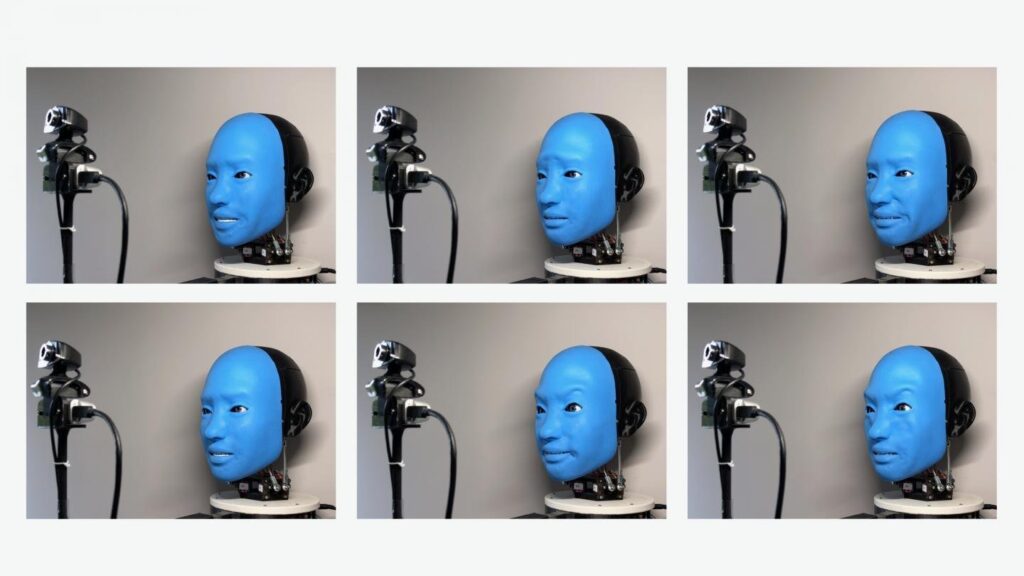

Para desarrollar su capacidad de imitar expresiones faciales, los científicos comenzaron a filmar el EVA mientras movía casualmente su rostro. Cuando la computadora que controlaba el robot analizó posteriormente las horas de filmación, utilizó una red neuronal integrada para saber qué combinaciones de "movimiento muscular" coincidían con las expresiones faciales humanas.

En la segunda fase de "entrenamiento", cuando una cámara conectada capturó el rostro de una persona que interactuaba con el robot, un segundo red neuronal para identificar las expresiones faciales de ese individuo y hacerlas coincidir visualmente con las que el robot pudo crear. El robot luego procedió a asumir esas "caras" moviendo sus músculos faciales artificiales.

¿Es útil?

Aunque los ingenieros admiten que la simple imitación de las expresiones faciales humanas puede tener aplicaciones limitadas, creen que aún podría ser útil. No es casualidad que tantos talleres estan trabajando sobre la reproducción de expresiones faciales. Por ejemplo, podría ayudar a mejorar la forma en que interactuamos con las tecnologías de asistencia.

"Existe un límite en la cantidad de personas que podemos interactuar emocionalmente con los chatbots o asistentes de voz basados en la nube", dice el líder del proyecto, el Prof. Hod Lipson. "Nuestros cerebros parecen responder bien a los robots que tienen algún tipo de presencia física reconocible".

No me digas que la próxima generación de Google Nest o Alexa será una cabeza hablándome, porque me estoy desnudando. Me voy, ¿eh?

Puede ver el EVA imitando las expresiones faciales en este video.