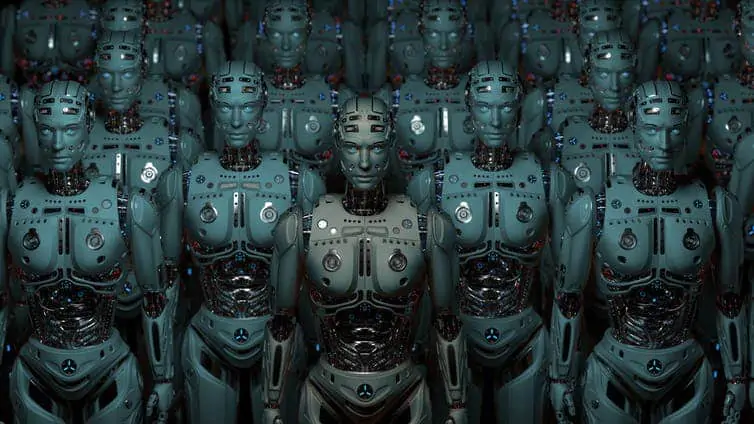

Las guerras futuras serán más rápidas y más tecnológicas, pero menos humanas que nunca: bienvenidos a la era de los robots soldados.

Hay un lugar perfecto para probar armas avanzadas: las Islas Wallops, una pequeña porción de tierra frente a la costa de Virginia que parece haber salido de la pluma de Asimov. Si un barco de pesca hubiera pasado por ese camino hace un año, habría visto media docena de balsas circulando en el área; una mirada más cercana habría revelado que las balsas no tenían a nadie a bordo.

Los barcos utilizaban un motor capaz de ajustarse al contexto y transmitir acciones y posiciones a todos los demás, organizando instantáneamente la flota según una estrategia. Incluso disparando, quizás para defender a las tropas estacionadas en la orilla.

El esfuerzo semisecreto, parte de un programa de la Marina de los EE. UU. Llamado Sea Mob, es una forma de dejar en claro que las máquinas equipadas con inteligencia artificial pronto podrán mover incluso ataques letales sin supervisión humana y en desprecio leyes de robótica.

Formulado por Isaac Asimov, uno de los padres de la ciencia ficción, las tres leyes de la robótica se publicaron por primera vez en un cuento de 1942. En sus novelas, el escritor ruso-estadounidense las cita a menudo: son principios rígidos, que no deben transgredirse, teorizados para tranquilizar a la humanidad sobre las buenas "intenciones" de los robots.

Quién sabe si Asimov había previsto que sus 'leyes' correrían el riesgo de desmoronarse como está a punto de suceder.

Muerte automática

La idea de enviar grandes máquinas autónomas y letales a la batalla no es nueva: Se han probado sistemas similares durante décadas, aunque defensivos, como los que permiten la cobertura de misiles hostiles. El desarrollo de la inteligencia artificial permitirá crear sistemas ofensivos que no solo responderán a los estímulos, sino que decidirán por sí mismos qué hacer, sin intervención humana.

Un humano tarda un cuarto de segundo en reaccionar ante la vista de algo (imagina el momento en que un portero decide dónde lanzarse durante un penalti). Las máquinas que hemos creado ya nos están superando, al menos en velocidad. Este año, por ejemplo, investigadores de la Universidad Tecnológica de Nanyang en Singapur entrenaron una red neuronal para absorber datos de 1.2 millones de imágenes. La computadora intentó identificar a los sujetos de la foto y tardó 90 segundos. 0.000075 segundos por foto.

Por ahora queda mucho por hacer: a esta increíble velocidad el sistema ha identificado a la persona de la foto solo en el 58% de los casos. Una tasa de éxito que sería desastrosa en la batalla. Sin embargo, que las máquinas pueden moverse mucho más rápido que nosotros es un hecho establecido y solo aumentará. Durante la próxima década, la nueva generación de misiles viajará a nivel suborbital, demasiado rápido para que un hombre decida cómo contrarrestarlos o manejar la situación. Atacarán bandadas de drones autónomos y otras computadoras responderán a una velocidad supersónica.

"Cuando la guerra se acelera, ¿en qué momento el ser humano se convierte en un obstáculo?" él se pregunta Robert trabajo, Jefe adjunto del Pentágono con Obama y Trump. “No hay forma de que intervengamos nosotros, así que delegaremos en las máquinas”. Aparte de Asimov, en resumen.

Armas que se hacen

En todos los aspectos militares de la actualidad, la investigación se compromete a garantizar un tipo de guerra más rápido, más preciso y menos humano posible.

La marina American prueba un barco de 135 toneladas llamado Sea Hunter, que patrulla los océanos sin tripulación, en busca de submarinos que algún día podrán derribar directamente. En una prueba, el barco viajó 4000 km desde Hawai hasta California sin intervención humana, haciéndolo todo por sí mismo.

El ejercito mientras tanto, desarrolla nuevos sistemas de "apuntar y disparar" para sus tanques, y un sistema de misiles llamado JAGM, Joint Air-to-Ground Missile. JAGM tiene la capacidad de elegir vehículos para atacar sin intervención humana. En marzo, el Pentágono solicitó fondos del Congreso para costar 1051 JAGM a un costo de 360 millones de euros.

¿Y la aviación? Todas las pruebas se centran en el proyecto "SkyBorg" (el nombre lo dice todo): una versión no tripulada del F-16 capaz de luchar por su cuenta.

Hasta ayer, los militares que querían provocar una explosión en un sitio remoto tenían que decidir cómo y cuándo atacar: ¿con un avión? ¿Un misil? ¿Un barco? ¿Un tanque? Luego tuvieron que dirigir la bomba, apuntar, operar un comando.

Los drones y sistemas como Sea Mob están excluyendo completamente a los humanos de tales decisiones. La única decisión que le queda a un comando militar (pero no debe tomarse antes y no contra el consentimiento de todos) es cuando los robots quedan libres para matar violando las famosas leyes de Asimov, quizás comenzando con los momentos en que las comunicaciones por radio se interrumpen durante una operación de guerra.

No es un asunto restringido solo a los Estados Unidos

Desde los 90 Israel Comenzó el diseño de un sistema llamado HARPY, que hoy diríamos de inteligencia artificial. El dron pudo volar sobre áreas cubiertas por sistemas de radar y atacarlas de forma independiente. Luego, la compañía vendió este sistema a China y otros países.

A principios de la década de 2000, elInglaterra desarrolló el misil Brimstone, capaz de encontrar vehículos enemigos en el campo de batalla y "determinar" cuáles atacar.

El año pasado, 2018, el presidente de la Rusia Vladimir Putin habló de un dron submarino equipado con armas nucleares, abriéndose a un escenario en el que un dispositivo automático podría tener en su equipo el arma más mortífera jamás fabricada por humanos. Y por otro lado el propio Putin admitió que la nación capaz de desarrollar la mejor IA "Se convertirá en dueña del mundo".

La China no se ha entregado a grandes declaraciones, pero el hecho de que sea una vanguardia en inteligencia artificial todavía nos hace pensar. Se estima que se convertirá en el país líder en este campo durante los próximos 10 años, y pronto podría explotarlo militarmente.

La guerra fría tecnológica.

El miedo a ser superado por países como China o Rusia ha llevado a los EE. UU. A gastar mucho en el desarrollo de la inteligencia artificial: $ 600 millones en 2016, $ 800 millones en 2017 y más de $ 900 este año. El Pentágono no ha revelado detalles sobre estos esfuerzos, pero de las entrevistas oficiales es fácil ver que los desarrollos en la investigación de la IA darán como resultado muchas soluciones de tecnología militar, incluso si no está listo de inmediato para tomar el mando por completo.

Sin embargo, puede suceder

La intensa inversión económica que está haciendo Estados Unidos para recuperar la certeza de la supremacía tecnológica (y por lo tanto militar) multiplica los riesgos de forzar la mano de las máquinas, o dejarlas forzar. Robert Work lo dice claramente: “Llegará un momento en que las máquinas 'cometerán un error' inducido por nosotros, porque no pretendemos tener la máquina perfecta, solo la más útil en el menor tiempo posible”.

La idea de que las máquinas pueden intervenir completamente por sí mismas para decidir matar seres humanos violando las leyes de la robótica de Asimov todavía pertenece a un imaginario que la rechaza totalmente: algo cercano a películas apocalípticas como Terminator. Pero estas no son posibilidades lejanas.

En un planeta de naciones cada vez más competitivas en este campo, la posibilidad de que las máquinas autónomas puedan causar daño a los oponentes también en términos de vidas humanas es real. No es agradable decirlo, y mucho menos escucharlo, pero es así.